让通用机器人走进每一个家庭

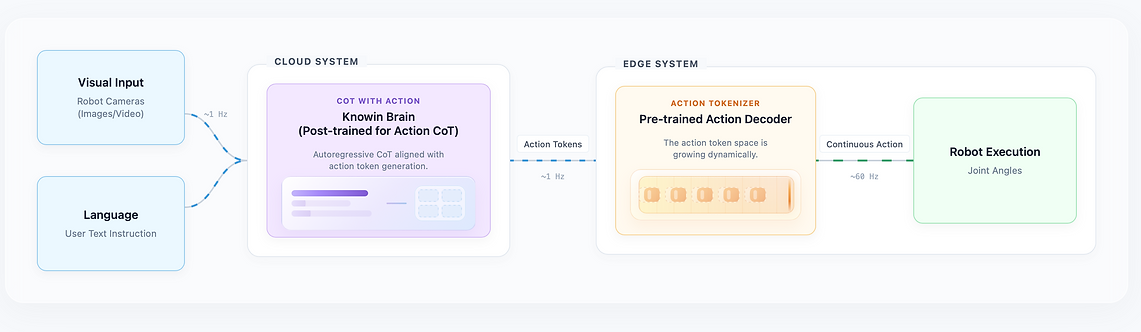

KNOWIN具身基础模型架构

为了实现机器人在开放环境中的高阶自主性,我们提出了一种生成式具身智能架构,从数据、认知到执行形成完整闭环。

1. KnowinDream:跨越"数据墙"的生成式引擎

高质量机器人轨迹数据的匮乏,是制约行业的根本瓶颈。KnowinDream 是我们基于视觉生成模型构建的数据引擎——从有限的真实数据中学习场景变化的规律,直接合成海量机械臂操作的训练视频,覆盖人工采集几乎无法穷举的极端光照、复杂材质与多样化上下文。它不是推理链路中的在线组件,而是整个系统鲁棒性的根基。

2. KnowinBrain:具备反思能力的具身认知基座

在云端,我们部署了登顶 Embodied Arena 榜单第一名的基础 VLM——KnowinBrain。我们创新性地利用KnowinDream生成的海量合成数据对其进行了深度的 Action CoT 后训练,将其与 Action Token 生成对齐,使其具备了进行自回归动作思考的能力。在 1-5Hz 的执行反馈机制下,经过后训练的KnowinBrain可以动态评估当前的物理状态,实现自主反思与策略修正,打通感知、规划与执行的闭环。

3. Action Tokenizer:生成式动作编解码器

架构图中的 Action Tokenizer,正是在 KnowinDream 合成的海量视频上预训练的成果。经过多维度物理环境的充分训练,它掌握了极其泛化的动作表征能力,能够将 KnowinBrain 生成的 Action Token 高效解码为边缘系统所需的 Action Chunk,确保机器人在面对未知的真实世界时,依然能可泛化的生成出平滑、精准的物理操作。此外,Action Token Space 并非静态的。随着 Knowin 不断解锁更多复杂的家庭应用场景,这一底层动作空间将持续动态扩容,赋予机器人不断进化的物理执行边界。

KnowinDream

生成式数据引擎

生成的理念不止于动作本身。KnowinDream 是诺因基于生成模型构建的数据引擎,从真实世界数据中学习场景变化的规律,直接合成机械臂操作的训练视频——包括那些人工采集几乎无法穷举的极端条件。

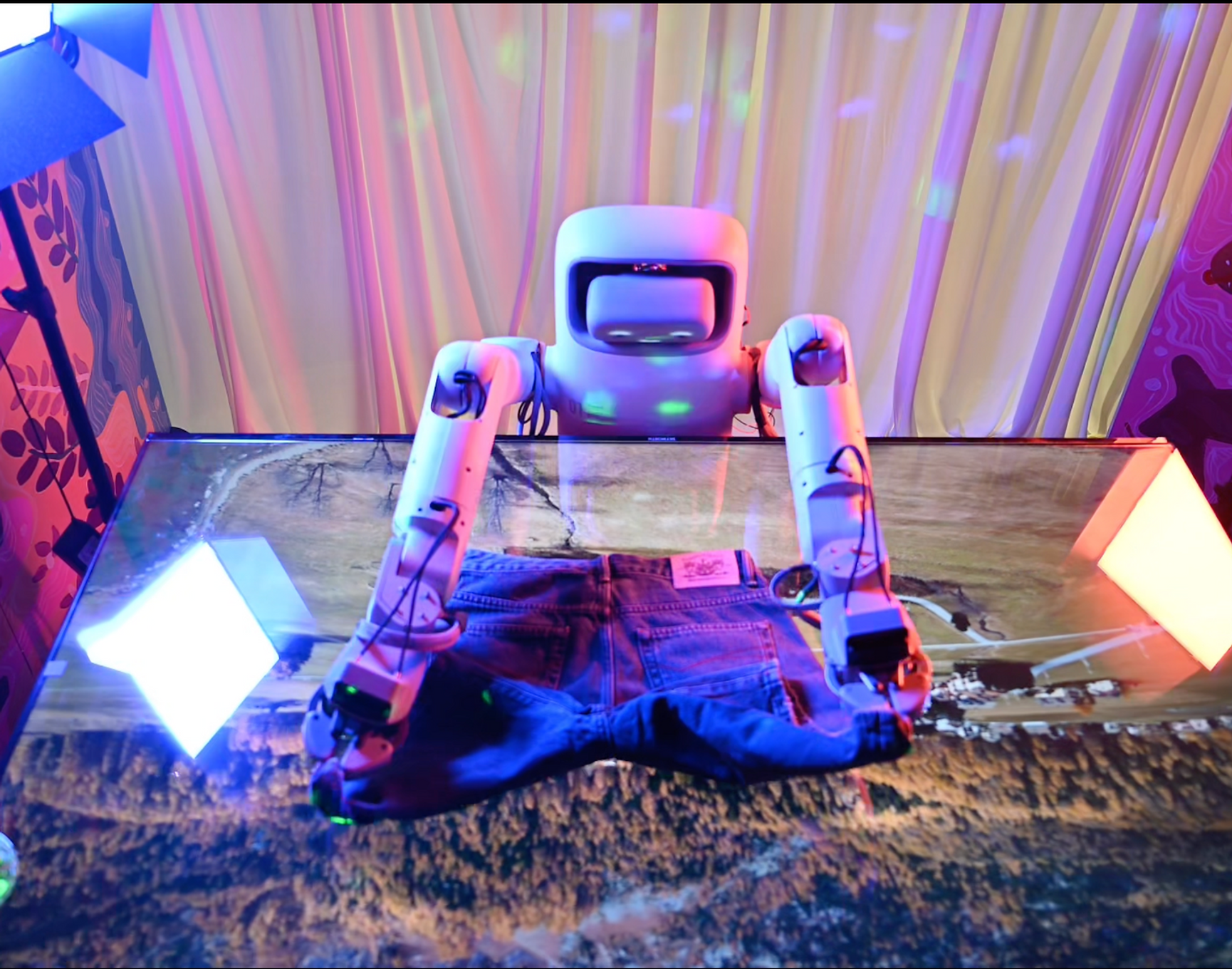

极端场景,同一模型

以衣物折叠为例:在电视屏幕上操作,面对动态光源与持续变化的画面干扰。系统未针对任何特定光照条件单独训练,这一鲁棒性源于 KnowinDream 对场景变化的充分覆盖。

关于我们

诺因成立于2025年7月,全球首创通用具身大模型新架构,开辟具身智能的下一代范式,致力于让机器人走进每一个家庭,开启人机共生的新纪元。诺因面向消费级家庭场景,打造具备物理实体、能够在真实环境中形成“感知—生成—执行—演进”闭环并持续交互的具身智能系统。

作为面向家庭消费级具身智能的探索者与先行者,诺因依托全栈自研能力、全新的生成式具身大模型体系与创新的合成数据路线,持续提升机器人在复杂家庭环境中的跨场景泛化、长链条闭环执行与可靠交付能力,聚焦现代家庭在陪伴互动、娱乐与高频家务协作等多元需求,为用户带来更智能、更自主、更省心的家庭服务体验。

联系我们

联系电话:17610340223

邮箱:HR@knowin.ai

公司地址:深圳市南山区粤海街道高新区社区科技南路18号深圳湾科技生态园12栋A2406